近日,实验室2024级硕士生张全玉一篇论文“Stabilizing Feature Geometry in Noisy Pretrained Models for Robust Downstream Tasks”(作者:张全玉,韩忠义,孙昊,宫永顺,王晓燕,尹义龙,李硕)被CVPR2026会议录用。CVPR是国际计算机视觉顶尖和权威学术会议之一,属于CCF A类会议。

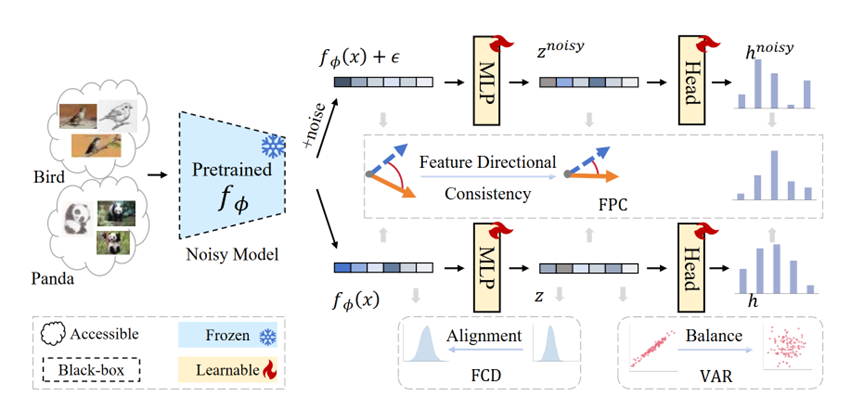

随着大规模预训练视觉模型在各类下游任务中的广泛应用,其在噪声数据条件下的泛化能力问题逐渐受到关注。近年来研究发现,预训练阶段引入的标签错误或图文错配可能被模型继承,并在微调阶段持续影响表示结构,从而导致性能下降,这一现象被称为“灾难性继承”(Catastrophic Inheritance)。现有工作通常从特征谱能量变化解释该问题,默认主特征方向保持不变,而本文发现这一假设并不成立,并首次系统揭示噪声预训练会导致特征主子空间发生旋转,从而削弱模型的语义表示能力。在可控噪声比例的预训练实验中,作者发现即使谱能量变化较小,主导特征方向仍会明显偏移。为定量刻画这一现象,论文提出主方向夹角(Principal Directional Angle, PDA)指标,用于衡量噪声模型与干净模型主子空间之间的偏离程度。实验表明,随着预训练噪声增加,PDA持续增大,并与下游任务精度呈显著负相关关系,说明特征方向失稳是导致泛化能力下降的关键因素。基于这一发现,论文提出特征几何稳定化方法(Feature Geometry Stabilization, FGS),在微调阶段引入轻量级投影模块并加入几何一致性约束,在无需访问干净预训练模型的情况下恢复特征子空间结构。该方法计算开销极低,可直接应用于大规模预训练模型,并在多种噪声预训练模型和跨域任务上稳定提升性能。研究结果表明,保持特征空间方向稳定性是缓解灾难性继承的有效途径。